目次

この記事は RECRUIT MARKETING PARTNERS Advent Calendar 2017 の投稿記事です。

みなさまこんにちは。リクルートマーケティングパートナーズの鶴田です。2017年度新卒エンジニアとして、普段の業務ではスタディサプリ進路チームにて、iOSエンジニア、ときどきデザイナなどをやっています。

研究その他では、ヒューマンコンピュータインタラクション (HCI)、ユーザインタフェース、超音波や光によるセンシング、デジタルファブリケーション、機械学習、デバイス制作やコンテンツ制作などが好きです。

今回、タイのバンコクにて 11/27-11/30 をかけて開催された SIGGRAPH Asia 2017 に参加してきたため、その様子を前・後編の2回に分けてレポートします。後編となる本記事では、本学会のレポートを詳しくご紹介したいと思います。

SIGGRAPH は、アメリカ合衆国を中心とする世界最大級のコンピュータサイエンス (CS) 学会たる ACM1)これと双璧を成す学会としては規格等でも有名なIEEEが挙げられます。 が開催する国際学会の1つです。ACM は数多くの学会を主催しており、SIGGRAPH はそのなかでも特に コンピュータグラフィクス と インタラクティブ技術 の研究に重きを置いた学会として知られています。たとえば、ディズニー、ルーカスフィルム、インダストリアルライツアンドマジック、マイクロソフトリサーチ、Unity などなどの企業や、他にも錚々たる大学の研究室等が古より文字通り最先端のCGにまつわる研究を投稿し、アカデミアと産業界が一体となってこの分野の発展に貢献してきました。CS系では最難関の学会の1つとしても知られています。また、日本からの参加が積極的な国際学会の1つでもあります。

端的に言うと、世界中から映画業界やゲーム業界、その他のクリエイティヴ関係の業界人や、関連分野の第一人者たる研究者たちが一堂に会する、いわば世界で一番大きいCGのお祭りです。

記事一覧

- 前編: 渡航・生活・設営

- 後編: 学会参加レポート <- この記事

会議の構成

さて、翌日より開催される SIGGRAPH Asia は、主に以下のような構成になっています。全てが厳正な審査をパスした内容となっており、このことが SIGGRAPH の質を高度に担保しています。これらのプログラムが、巨大な会場で3日間2)夏は5日間あります!パラレルに開催されます。

Sessions

主に圧倒的完成度のテクニカルペーパー (フルペーパーの技術論文) などの登壇発表がこれにあたります。古くからのSIGGRAPHの醍醐味である、キレッキレの State-of-the-Art なCGとインタラクティブシステムの研究が紹介されます。フルペーパーは最難関の査読 (peer-review) を通っています。また、重要な招待講演なども開催されます。

Emerging Technologies

テクニカルペーパー等に対してまだ完成度は及ばないものの、最高にカッティングエッジな研究を、デモ形式で体験できます。日本人研究者が割と多く、同窓会の様相を呈します。査読付き。

Posters

カッティングエッジだがデモが困難な研究などをポスター展示する形式の研究発表です。査読付き。(ReverseCAVEチームは、夏の SIGGRAPH 2017 において Posters プログラムで開催される Student Research Competition でメダルを獲得しました)

VR Showcase

VRの村です。近年ふたたび注目されているVR、ARやMR関係の研究を全力でデモ展示し、来場者も全力で体験することが可能なゾーンです。今回 ReverseCAVE チームが出展しているのはここです。

Art Gallery

インタラクティブ技術を用いてアートの目線から個々人のテーマに切り込む展示です。哲学的な問いが思い思いのテクノロジーで表現されています。

Courses

いくつかのテーマに沿った講義が設計され、各分野の第一人者である研究者(たち)が講師となり、座学やパネルディスカッションを受講したり、ハンズオンを受けることができます。

Computer Animation Festival

映像企業やゲームメーカー、学生など様々な層の応募者が最新の技術を惜しみなく駆使して制作した短編CGアニメーションを連続上映するお祭りです。毎年楽しみにしている参加者が多いのではないでしょうか。会期中様々な会場で部門ごとに放映されますが、いくつか部門賞があります。なかでも最大規模の Electric Theater では、巨大な会場やスクリーン、ラインスピーカを用いて受賞した全ての作品や優秀な作品をメドレー上映します。解説セッションもあり、例えばディズニーの未公開最新作のスニークピークや、スターウォーズ、ブレードランナーなどの最新作におけるCGクリエイションのブレイクダウンなどを、ディレクターやクリエイター本人が解説するという、なんとも贅沢な空間が広がっています。

ここまで見ただけでも、どうも回り切れそうもないですね…! 😂 今回は、自分の出展があったため勿論そちらが主務となりましたが、できる限り業務に関係ありそうなセッション (教育・VRなど) や、各種デモブースを体験してきました ! また、テクニカルペーパーに関しても ( 完全に個人の趣味ですが ) 興味があるものをできる限り紹介できればと思います。

1日目

会期1日目は主にReverseCAVEのデモシフトに専念し、夕方以降軽く会場全体を回って調査、その後教育系のセッションに参加。最後はレセプションに出席しました。

Opening

いよいよ始まりました SIGGRAPH 1日目。オープニングセッションでは今回の投稿に関するまとめが読み上げられます。

今回はアクセプトされたうちの312の投稿が最終的にトーク・デモされます。論文の著者は30ヵ国、1118人がパスしました。論文はコミッティーの40人のエキスパートと、552人の外部査読者によって厳正に査読され、1672 ものアツいレビューが著者らと交わされました。

これは閉幕時の集計ですが、今回は各国から6400人 (!!) のプロフェッショナルやこの分野に興味のある人々が参加しました!3)ちなみに夏のSIGGRAPHの参加人数はもっともっと多いです。

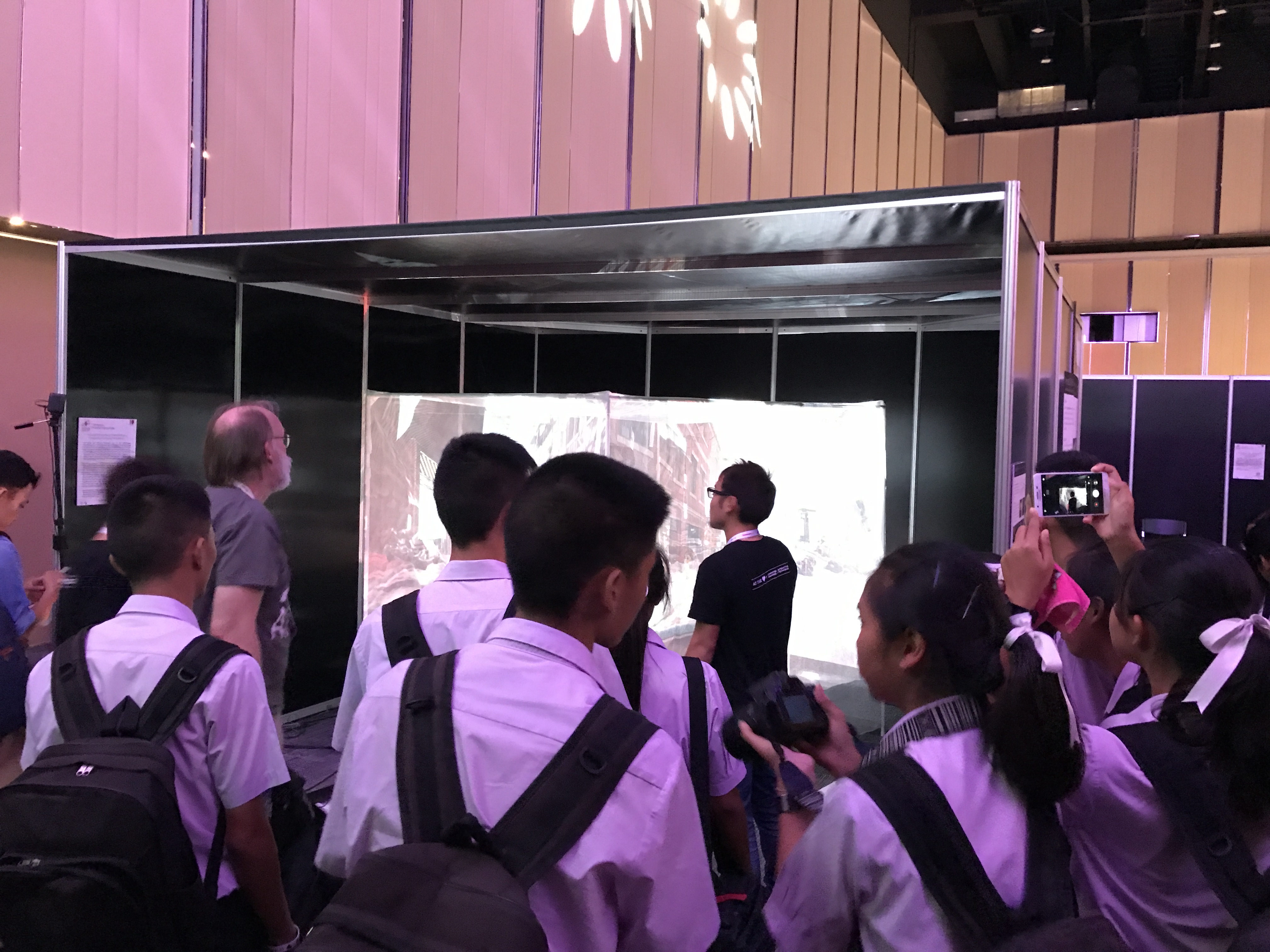

ReverseCAVE デモ展示

ReverseCAVE は、HMD4)ヘッドマウントディスプレイの略。コンピュータグラフィクス (CG) によって作り上げたVR空間等に没入するために、体験者が頭部に装着するゴーグル型のデバイスです。VR用のHMDは、ユーザーの現実への視界を一切遮ったうえでVR空間を表示します。現実の空間にシースルーのHMDなどを用いてCGを重畳表示し、現実を情報で拡張した状態で視認するのはARと言い概念が別れています。基本的に、これらのHMDを装着したユーザーが何を体験し行動しているかということは、外見から判断するのは難しく、不可解な様子に見えてしまいます。を装着しているVRプレイヤーだけでなく、その周囲にいるHMDを装着していない人たちもVRコンテンツを楽しむことができるような、VRコンテンツの新たなインスタレーション手法です。弊社からは筆者 (鶴田) が参加しています。このプロジェクトは9人のメンバーで構成されています。本研究は筆者が筑波大学の修士課程に所属していた際に取り組んでいたいくつかのプロジェクトのうちの1つとしてスタートしました。そして、同じく筑波大学修士課程の学友と共に、Jointed First Author5)最近 (?) は特定の学会では「均等に最も貢献した」複数人の著者を同列に筆頭著者とすることができます。 として研究・執筆・投稿しているテーマです。

その意義と解決方法はこちら。

ReverseCAVEは、VRコンテンツをヘッドマウントディスプレイ(HMD)上で表示すると同時に、周囲に設置した半透明スクリーンに裸眼で視聴できる立体映像としてリアルタイムで投影し、HMDを装着した人と周囲にいる人が、同じ空間内でそれぞれの位置や視座に応じたVR体験を共有できるようにします。近年、VR活用の広がりは目覚ましく、特に3Dコンテンツを用いた映像表現分野やエンタテインメント分野では最も注目される技術の一つです。従来のコンテンツ(テレビゲームや映像作品)はモニター越しに周囲にいる人たち全てが同一の体験をすることができた一方で、VRはその特性上、HMD等の専用機器による視聴が前提となるため、HMDを装着した人と、装着していない人では、同じ空間にいても視聴体験を共有することはできません。仮にモニター等でHMD装着者と同一のコンテンツを視聴できたとしても、2次元環境で表現されるため、その体験には大きな差異が生じます。我々はこの制約を取り払い、空間そのものをメディア化することにより、これまでにない映像コミュニケーションの創出を目指します。

ReverseCAVE project

今回はそのデモ展示を行ってきました。以下は実際の様子になります。

小難しいことを言っていますが、簡単に言うと、

わかる… わかるぞ… しかもたのしい!!!!!! (^o^)

今回は参加型のデモ展示のため、コンテンツはキャッチーなVRゲームとしました。敵がたくさん現れて自分を撃ってくるので、その弾を掴んで (!) 投げ返したり、念力を使ったりして敵を倒してゆく、全身で楽しめつつさっくりクリアできる、アーケード風のゲームとなっています。

↓実際に近くでみるとこんな感じ↓

デモブースが VR Showcase、Emerging Technologies、Art Gallery を含めた Experience ゾーンの一番奥、しかもある程度環境を暗くする必要があるという制約のため、はじめはぜんぜん見に来てもらえないのでは… とおもっていました。が、

大人気でこの人だかり。ゲームもできるので、待機列まで…

たくさん用意していた解説ポストカードもあっという間に無くなり、他にも色々と想定外の事態も起こりましたが、無事デモ期間中は盛況となりました。

頂いたコメントの例

- e-sportsに最適だと思うからぜひやってほしい。

- こんなにシンプルなのに、まったく灯台もと暗しで思い付かなかった。こんなふうに解決するのは目からウロコだった。

- 何も付けずに周りから見ているだけなのに、HMDをつけてゲームをしているひとと、一緒になって楽しめたり応援・協力できるのが楽しい。

- 海外のゲーム市場でとてもウケるとおもう。

質問と回答の例

Q: 円筒形や、VRドームみたいな感じで半球とかも見たい。なぜ立方体?

A: 今回はセットアップが簡単であるため立方体の蚊帳をそのまま使用しました。今回のようなエキシビション等では、素早く展開し展示を開始できることが、オペレーションの観点でとても重要になります。もちろん、投影の仕方により円筒形やドーム型のスクリーンに対応することもできます。今後はモジュラー化等を進めて、柔軟な形状への対応と可搬性を向上する予定です。

Q: ゲームエンジンは何を使っている?

A: Unreal Engine を使用しています。これは主にデモ展示においてコンテンツのクオリティを担保するためです。プロトタイプや、研究段階では、周りの傍観者の動きもトラッキング6)今回は傍観者のトラッキングは省略しています。していましたが、その際はUnityを使用していました。

Q: アートディレクションやゲームコンテンツ制作も著者がやったのか?

A: いいえ。今回、アートディレクション、コンテンツ制作はプロフェッショナルのVRクリエイターの方に依頼し、クオリティの高いコンテンツを作成して頂くことに叶いました。全ての技術において言えることですが、みなさんに理解し楽しんでもらうためには、見せ方という観点が最も重要になります。こういった意味で、コンテンツはもっとも愛すべき部分なのです。

Q: 外側のスクリーンに投影されている視点は固定なのか?またそれでよいのか?

A: はい。プレイヤーはVR-HMDとして HTC Vive を装着していますが、これには「ルーム」という、プレイヤー自身が自分の足で動き回ってよい範囲が存在します。その境界を、プレイヤーが世界を見る窓ととらえ、4つのカメラをプレイヤーの外側に向けて彼を取り囲むように固定配置し、プレイヤーの周囲360度の画像をとらえ、実際の半透明スクリーンに整合性を保って投影しています。つまり、現実の世界で、VRの外側にいる我々はプレイヤーと完全に同一の世界を共有していることになります。以上のことから、投影する映像を撮影するVR空間内のカメラ位置は固定で良く、これが傍観者とVR空間の整合性を保つために必要な条件です。またHMDの中に投影されているプレイヤーの見ている映像の方は、プレイヤーの向いている方向をトラッキングしており、プレイヤーには思うとおりの方向の映像が見えています。

Q: ゲームはリリースされている?

A: いいえ。今回展示しているコンテンツはオリジナルの構成になっているため、リリースはされていません。ただし、UnityやUnreal Enginにより作成されたゲーム等であれば、容易にReverseCAVEのメソッドをインストールし応用することができます。

Q: 中のプレイヤーもHMDなしでプレイできるのでは?

A: たしかに! 部分的にはそのとおりかもしれません。現在はVRプレイヤーのみに見えている情報 (例えば自分の身体がCGで表現されているなど) も少しだけ存在します。そのため、プレイヤーにはより没入感を高めて楽しんでもらうためにHMDを装着してもらっています。また、今回の研究の主眼はHMDに閉じこもった体験を、周囲に共有して皆で楽しむということにあります。そのため、HMDを用いない協調型のエンタテインメントいおいては、他にもっと様々な手法が考えられるでしょう。

Q: 周りから見た際、自分が立った目の前のスクリーンだけ前後が反転しているのは改善してほしい。

A: おっしゃるとおりです。これは課題の1つなので、解決したいところです!

Q: 背景が固定では味気ないので、背景がグリグリ動く系のゲームだともっとReverseCEVEの意義が伝わるのでは?

A: ありがとうございます。その通りだと思います。我々もフライトシミュレータやカーレースなど、背景がダイナミックに動く様々な案を検討しました。今回は、プレイヤーがたくさん体を動かして楽しんでいる様子を共有していただきたかったため、全身を使ったシューティングゲームを採用しました。

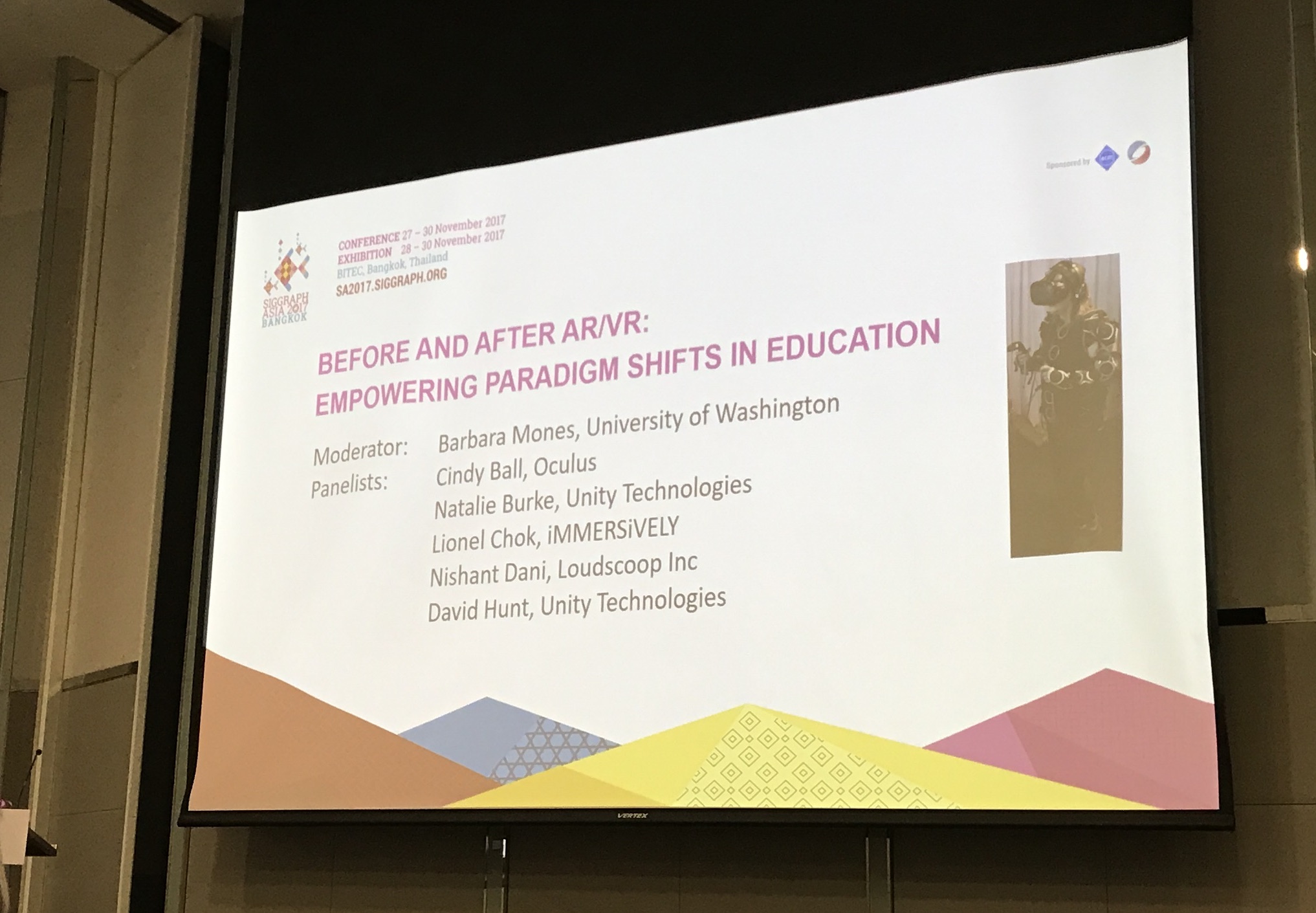

Education Special Session 1: "Before and after AR/VR: Empowering the Paradigm Shifts in Education"

筆者の事業ドメインが学習・進路領域ということもあり、SIGGRAPHでは異色 (?) の教育系セッションに参加してきました。

始めに参加したのは、「VR/AR が教育をどのように変えるか」をテーマとしたパネルディスカッション形式のセッションです。ワシントン大学の Barbara Mones をモデレータに、ほか Oculus や Unity などから総勢6名が集結し、VRと教育についてアツい議論を交わしました。

始めに参加したのは、「VR/AR が教育をどのように変えるか」をテーマとしたパネルディスカッション形式のセッションです。ワシントン大学の Barbara Mones をモデレータに、ほか Oculus や Unity などから総勢6名が集結し、VRと教育についてアツい議論を交わしました。

はじめに Oculus Education の Cindy Ball が、教育における意義として、「異なる理解の段階に居る人々が新しいレベルで理解しあう」というテーマを提示しました。そして具体例として職業訓練を挙げ、宇宙ステーション研修や、刑務所にいる若者がアントレプレナーシップ研修を卒業するプログラムなどを紹介しました。

その後複数の登壇者から、VRを教育に用いる意義や、様々な問題提起などが行われました。

VRは、たとえ複雑なこと、高度に危険なこと、遠隔していること、高価であるような物事を学びたい場合であっても、これらを乗り越えることができます。この要因の1つであるVRの強みとして、フィジカル8)ここでは「実際の身体的」という意味で使用します。なフィードバックにあえて選択性を残せることがあると筆者は考えています。紹介されていた具体例では、細胞のことを細胞の中に入り込んで内側から学んだり、同じ3次元空間をVRで共有し、立体的な図を複数のユーザーで描きながら議論をする様子などが挙げられていました。

教育における方法のひとつとして、アダプティブラーニング9)生徒1人1人に学習内容・学習方法をマッチングする手法です。複数の生徒が同じ学習内容・学習方法にマッチすることもあります。がありますが、本当にアダプトできているのか? ということは大きな課題です。この問題を、VRによって作成した学習アプリによる指導と創発的な学習によって解決しようとする取り組みも紹介されました。3D空間内に様々な形状で展開していく立体的なノートを作成し、これを用いて学習を行う様子が一例として示されました。デバイスとしては、教育用途にと Apple から大量に型落ちのデバイスを貸してもらうことができたそうです10)おそらくこれをスマホ用簡易HMDで使用したのでしょうか。。

また、ストーリーテリング (読み聞かせ等) においてもVRを用い、子供の創発的な学習・創造の能力を伸ばすことを期待した取り組みも紹介されました。

VRコンテンツそのものを作成する、VRクリエイターに対する教育といった観点からも提言がありました。VRはVRの中でクリエイションするべきである、というものです。既存のCGを用いたVRコンテンツの制作では、イメージをスケッチし、それをマウスやキーボードによってモデラーでぽちぽちとモデリングすることによって、ひとつひとつの構成要素を形作っていました。しかしこれは膨大な時間と手間がかかります。これが何故面倒なのかの詳しい説明は共通認識であると思われるため語られていませんでしたが、3次元空間に存在させたいものを、いったん2次元空間を動く操作子を介して作成しているからではないかと考えられます。また、これに対応するために、3次元空間を入力に用いた3Dモデリング手法が昔から研究されています。3次元のものは3次元でつくるのがいい。シンプルな話です。HMDやこれに附属するハンドトラッキングデバイスが HTC Vive や Oculus によって普及した今、これが高度に現実のものとなりつつあります。デモムービーでは、実際にCGにより構成されたVRの世界のなかで、クリエイターがそのままCGで作成された世界の構成要素を編集する様子が映し出され、非常にストレスなくひょいひょいと建物や山などを作成、構成し、マップを作成している様子を見ることができました。

このような創作の方法は Experimental Learning として教育にも活用できます。なぜなら単純に、人間が普段生活している3次元空間を再現しつつ、今まで困難であったような学習コンテンツを提供することは、それまで代替として用いられていたドリル形式の学習とは異なる体験を得られるためです。学習者が自分でその学習ドメインにおける空間を探索し、自らの手で発見を得られるような学習環境が、VRによる教育によって実現すると考えられます。

まず、「5年後、10年後の教育はどうなっている?」 という質問に対しては、「どんな年齢の子供でもスマートフォンを持つようになり、これを活用して学習をするのはもはや当たり前になるだろう」ということ。また「このように学ぶことは手軽になるだろうが、その選択肢が多くなりすぎ、どうやって学んで良いか分からなくなることもあるのではないか」ということが提言されました。これに対し、「教育用コンテンツを集めた共通のマーケットプレイスのような場所があれば良いのでは」といった提案もなされていました。現状でも App Store などがその役割の一部を担っていますが、教育用のVRコンテンツに関しては未だ一元的に探すのが困難です。また10年後の展望では、「ハプティクス等のフィードバックがこれまでよりも十分に実装されたVRデバイスが登場するだろう」とし、さらに学習者がリアルな環境で学習できるようになることを期待する声が上がりました。

質疑では、「VRによる教育においてHMDを用いた場合、目の機能として対象年齢があると思うが?」 という問いに対し、Oculus からは、「Oculusのような方式のHMDの場合は13歳以上での使用が推奨される」との回答がありました。また、「教師自身はどのようにしてVRを用いた生徒たちへの教育方法を学習すればよいのか?」 という質問に対しては、「これも実際に生徒と同じようにVR環境の中で教材を作ったりといった方法で指導方法を自ら考えるのが良いだろう」との回答がありました。

レセプション

さて、1日目のシメはレセプションパーティーです。立食パーティーの形式をとっており、各国の研究者の方々と飲み物やご飯を楽しんだり、仲間たちとワイワイ同窓会などをするような趣旨になっています。このレセプションは毎年盛況で、ステージパフォーマンスなども行われます。

2日目

2日目は主にトークセッションに参加しました。また Computer Animation Festival の Electric Theater が開催されました。

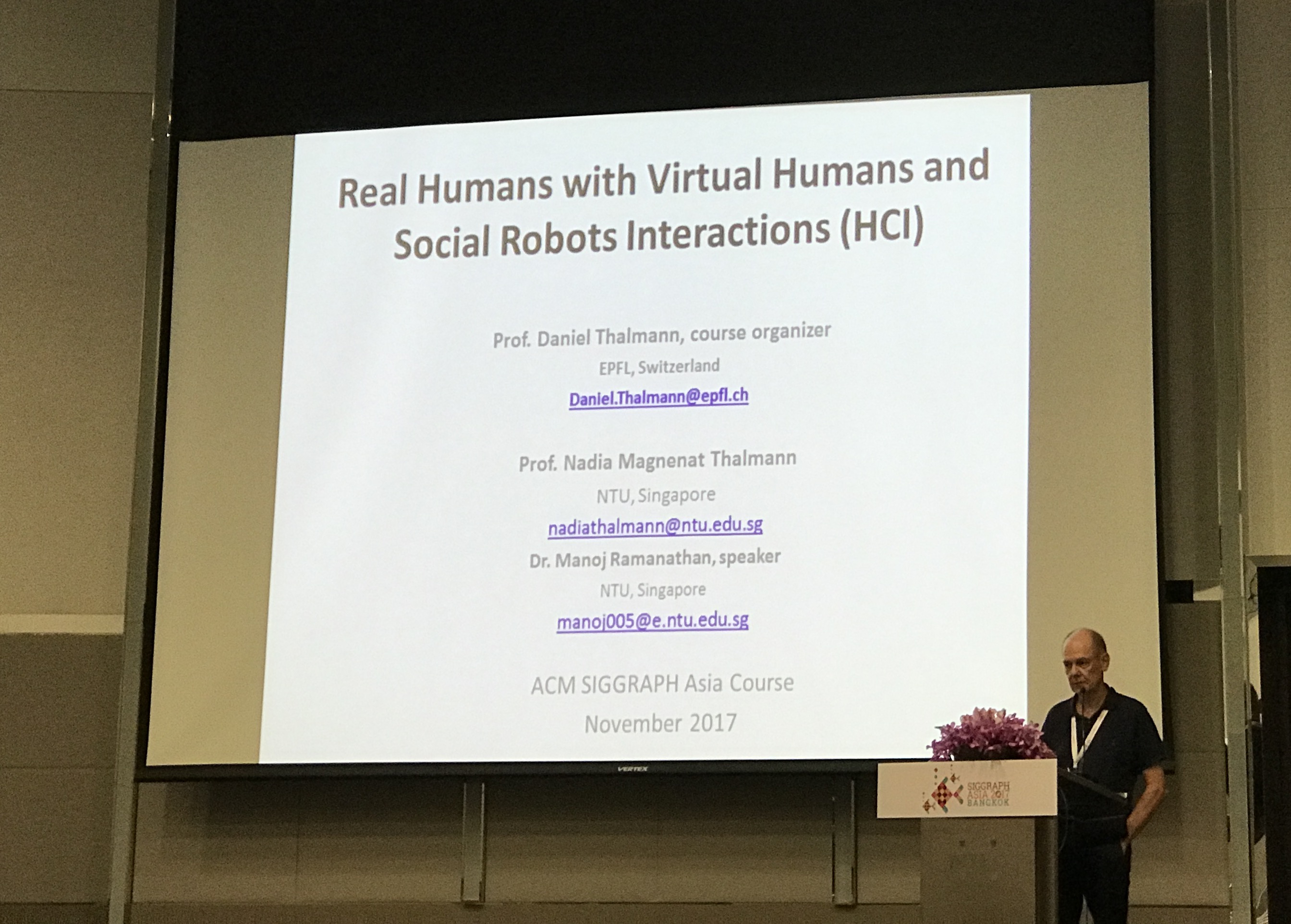

Short Course: "Real Humans With Virtual Humans And Social Robots Interactions (HCI)"

Course は、その名の通り授業形式のセッションです。今回は「ソーシャルロボット」に着目した、スイス連邦工科大学ローザンヌ校 Daniel Thalmann 教授の研究についての講義に参加しました。

Course は、その名の通り授業形式のセッションです。今回は「ソーシャルロボット」に着目した、スイス連邦工科大学ローザンヌ校 Daniel Thalmann 教授の研究についての講義に参加しました。

ソーシャルロボットとは、他者の行動を読み取り11)人間にとってはこれが「理解」しているように感じられます。、ジェスチャ、表情、アイコンタクトなどを自然に行いながら、コミュニケーションをとるロボットです。他の産業用ロボットや、画面の中や音声だけのコンシェルジュシステムとはちがい、Embodied なことが特徴です。これはシステムが人間に似た身体を持っているということです。このおかげで、人間はより違和感なく自然に、親しくエキスパートシステムと対話をすることができます。相手が自分のことを理解して話を聞いてくれているという実感が湧くのです。

ソーシャルロボットは、ユーザの顔や動き、そして個別のユーザーを別々の人物として識別します。顔検出には NEC の Neo Face12)この分野は昔からNECが最強です。、表情検出には Affectiva 社の AffectivaAPI が活用されています。

実際に、ソーシャルロボットと、人間2人と、画面の中のロボットとで会話等のインタラクションを行ったデモや、コンシェルジュとしてソーシャルロボットを用いたデモのムービーを見ることが出来たのですが、実際のソーシャルロボットの応答速度やアーティキュレーション13)発音、表情、動きの強弱や抑揚。には目を見張るものがあり、筆者の想像をはるかに超えていました。本講義で紹介されていたソーシャルロボットは人間型ですが、歩行はしないタイプでした。もしもですが、ボストンダイナミクス社などの、アクロバティックな動きもできるようなヒト型ロボットがもっと人間味を得て、そんなロボットにスポーツを指導してもらうようなときが来たらと考えると、ワクワクがとまりません。

筆者としては、先の節でも挙げたような、教育における「異なる現実 (VR)」における体験と学習について考えたとき、VRにおけるフィジカルの欠落、特に対VR人間に対するインタラクションの質が低い現状を補完するのが、ソーシャルロボットなのではないかと感じました。つまり、VRによって体験が拡張された人間とロボットは相性が良いのではないか、ということです。

Education Papers / Short Talks Session

前節とパラレルで進行していた、教育系の論文発表もさっくりとだけ聞いてきました。

Teaching Virtual Reality with HTC Vive and Leap Motion では、VRを用いた教育ではなく『VRそのものの習得』という意味でのVR教育について議論していました。著者によれば、VR教育の現在の問題点は「体験にフォーカスされていない」ということでした。なぜなら、別の空間に完全に没入するためには、体験というものが欠かせないからです。ここでの体験とは、デザイン用語に置き換えるなら『UX』と言うと分かりやすいでしょうか。筆者らは、よりリッチな「体験」を提供するための方法論を、HTC Vive と Leap Motion14)空中のハンドジェスチャをトラッキングできるIRカメラです。 を用いて構築していました。また、知見として Google Cardboard のようなスマホを用いた簡易HMDや Vive のようなそれなりの価格のしっかりしたHMDでは、得られる体験やユーザーが自発的に出来ることの幅も違うので、『教育の目的に応じてこれらを選択するべき』とのことでした。

SeLL: Second Language Learning Paired with VR and AI では、中国出身の著者が、外国語を習得するというドメインにフォーカスし、VRとARを組み合わせてこの学習の質を向上するという取り組みについて議論しました。どういうことかというと、とてもシンプルに、VRでは没入できる環境、たとえば外国の街角などをデザインします。そしてその地に降り立ったユーザーは、AIにより構築されたVR中のアバターと会話することにより、心身ともに異なる国や環境へと没入した状態で言語学習を行うことができます。AIアバターが会話のみならず発音評価なども行ってくれることにより、従来の受動的な学習から質を向上しようとしているようです。こちらの研究は work-in-progress なノート形式で評価実験は不十分であったため、質疑では、それぞれVRだけ、またはAIアバターだけをオミットした環境を構築し、それらの場合との比較実験を行うべきとの提案もなされていました。

Computer Animation Festival (Electric Theater)

SIGGRAPH のエモさがこれでもかというくらい凝縮された濃厚な時間です。今回も世界中の応募の中から23件の作品が選出されました。夏の SIGGRAPH で受賞した作品も前半に放映され、つづいてたくさんの新作が放映されました。またインディーズのみならず市販ゲームの映像作品もよく選出されます。会場ではいつも No Photo / No Recording のため、以下にトレイラーをどうぞ。

絶対観るんじゃ。

Best Student Project に選出され、これまでも数多くの賞を総なめにしているショートムービー、"GARDEN PARTY" は特に必見です。トレイラーは一瞬で終わってしまうので、どうにかして全編通して観まししょう。それだけの価値があります。

以下はおまけ。

↑ 夏の SIGGRAPH 2017 のトレイラー。FFXVもあるよ!

↑ こちらは2013年のトレイラー。たぶん近年で most エモ。一般的にもかなり有名になった動画です。1080pで全画面&爆音でみてね!!!! (アサクリもあるよ!!)15)しかしこうやって見てると年を追うごとに進化がすさまじいです…

3日目

最終日となる3日目は、体験型の出展をめぐることに専念しました。Technical Paper も最後に紹介します。

Experience Hall

Experience Hall には Emerging Technologies / VR Showcase / Art Gallery / 企業ブース が一体となった、体験型の研究等が集められています。

Emerging Technologies

みんな大好き E-Tech です。日本人多し。

Interactive Midair Odor Control via Ultrasound-Driven Air Flow

香りを伝播させる (!) 東京大学の研究です。フェイズドアレイだ!! と思ってダッシュで見に行きました。なんのことやら…? 落ち着きましょう。

まず写真奥の装置がありますが、これは超音波を発生する超小型トランスデューサ16)スピーカーと思って下さい。をマトリクス状に並べたものです。黒い四角がいくつか並んでいると思いますが、これを構成する黒いつぶつぶ1つ1つがそうです。各トランスデューサから位相をずらして超音波を放射することにより、計算した方向の1点のみに集中して強い音波を発生させることができます。ピンときた方はいると思いますが、この技術は大昔、まずはじめにアメリカにおいて電磁波で実現されました。そう、レーダーで実用化されたのです。フェイズドアレイレーダーというものを聞いたことがある人も多いと思います。イージス艦の艦橋に付いている大きな固定の平たいレーダーです。昔ながらのレーダーは360度の視界を見るのに自らがくるくる回転する必要がありますが、フェイズドアレイレーダーならば小型の固定アンテナを大量にマトリクス状に並べることで、好きな方向に電波を飛ばすことができます。写真のこの装置は、出すものを電波ではなく音に置き換えてつくったものと思ってください。この超音波フェイズドアレイは、当研究室で開発され、以前から様々な研究に応用されています。このシステムを用いることにより、人間の耳には聞こえにくい音の力を一点に集中させてモノを動かしたり、音のビームを作ったりすることができます。

本研究では、奥のフェイズドアレイから適切に発せられた超音波が、手前のアロマディフューザーの霧を適切にユーザーへと届けます。音によって発生する圧力を音響放射圧と言いますが、しかしこれを利用してなんと香りを好きな方向に伝播させるとは、誰が考えつくでしょうか。ここに訪れるだいぶ以前からこの香りの研究の存在は知っており、また最近匂い系は盛り上がってきているとはいえ、初めて見たときはもう、アホだなー!!!!! (注: めっちゃ大好き、という意味の褒め言葉です!!) と言って研究仲間と大爆笑していました。そんな大好きな研究だったため、体験したくてウズウズしていたのですが、今回初めて実際に体験できました。なんといっても様々な方向から様々な匂いがやってきて、それが高速に切り替わったり混ざったりと、現実ではあり得ないような体験に頭が混乱してしまいました 😂

OptRod: Operating Multiple Various Actuators Simultaneously by Projected Images

光に受動的な小型モジュールが群を成して自由な形状を構成することにより、様々な表示やアクチュエーションを行うことが可能なデバイスです。大阪大学の研究です。写真中央に平置きされているディスプレイの上にのっているハニカム構造の物体がそのデバイス群です。このように画面の上に本デバイスを置いた場合、デバイス1つ1つの接地部分が受光素子になっており、仮面に表示される模様や様々なパターンを入力として受け取ります。デバイスの上部は発光素子やアクチュエータになっており、下から受け取った信号を様々なアクションに変換して上部に伝えます。個々の小型デバイスはハニカム型に磁石で自由にくっつけていくことが可能となっています。もともとのモチベーションは、inFORM などの形状ディスプレイやピンドットマトリクスのハプティックディスプレイが、かなり大がかりな装置を必要とする現状をなんとかしたかった、ということろからスタートしたとのこと。完全にパッシヴなモジュール群なので、例えば入力した光のパターンによってモジュール同士が勝手に通信して結果を出力する、といったことも出来るそうです。

HapBelt: Haptic Display for Presenting Vibrotactile and Force Sense using Belt Winding Mechanism

DCモーターを用いてリボンを巻き取ることにより発生する剪断力を用いて、様々なタイプの触覚を味わうことができるハプティックディスプレイです。電気通信大学の研究です。振動や剪断力のみならず、ハンガー反射を発生させることにより特定の方向から力が加わっているような体験を得ることも可能です。ヘッドバンドやリストバンドなど様々な小型のモジュールを試作されており、これらを組み合わせて使用することも想定されています。実際にヘッドバンド型のデバイスを体験してみましたが、左右からフックを受けているような感覚 (首が左右に振られる感覚) などを錯覚することができました。

Demonstration of the Unphotogenic Light: Protection from Secret Photography by Small Cameras

スマートフォンなどの小型カメラによる映像コンテンツの盗撮等を防ぐ手法の、筑波大学の研究です。人間があまりにも高速な映像の変化を認識できないことを利用し、映像に盗撮防止パターンを挿入し高速プロジェクションしています。この盗撮防止パターンは人間には感知されず、カメラにのみ写ります。上の写真はダイナミックレンジが足りず白飛びしてしまっていますが、奥に写っているのがスクリーンに高速プロジェクションされた撮影対象の映像、手前に写っているのが実際に盗撮防止ノイズがのったスマホカメラの映像です。裸眼では、奥の画面のみが通常通りの映像として見えます。著者に聞いた話では、まさにこのデモを行っている最中に「同じような特許を持っているよ」という方がブースを訪れたそうです。恐らく手法はまた違うと考えられますが、こういうことが起こるのが、研究…!! なのです!

Telewheelchair: A Demonstration of the Intelligent Electric Wheelchair System towards Human-Machine

Telewheelchare は、VRを用いた車椅子の遠隔操縦による介護者支援システムです。被介護者に比べ介護者の割合が不足していることに着目した筑波大学の研究です。利用者がジョイスティックで操作可能な市販の車椅子をアップデートして使用しています。座席後部の高さをとった位置に全天球カメラを装備し、この全天球映像を遠隔地にいる介護者のHMDに映し出します。これにより、介護者は負担が軽減された状態で車椅子の操作が可能になります。また、機械学習による物体検出手法のひとつであるYOLOを用いて、周囲の状況を察知します。これにより、飛び出しによる緊急停止や、介護者が見えていない死角における危険要因の回避、基本的な壁のぶつかり回避などが自動でアシストされます。デザインもこだわっており、「車椅子をファッションのようにしたい」という熱意が伝わってきました。

VR Showcase

我々も出展していた VR Showcase には、沢山のダイナミックな体験型のリサーチがありました。今回はその中から1点だけご紹介します。

BoEs: Attachable Haptics Bits on Gaming Controller for Designing Interactive Gameplay

VRゲーム等のコントローラに、様々なフィードバックを与えるモジュールを組み合わせ、目的に合わせたコントローラを簡単にカスタマイズできるというデモです。筆者は風や振動、加えて霧や雨滴などまでもが再現されるモジュールを組み合わせて体験してみましたが、想像していたよりも没入感が激しく、終始「うわっ!うわ!!」と驚きっぱなしでした。

VRゲーム等のコントローラに、様々なフィードバックを与えるモジュールを組み合わせ、目的に合わせたコントローラを簡単にカスタマイズできるというデモです。筆者は風や振動、加えて霧や雨滴などまでもが再現されるモジュールを組み合わせて体験してみましたが、想像していたよりも没入感が激しく、終始「うわっ!うわ!!」と驚きっぱなしでした。

Art Gallery

アートギャラリーは、主にテクノロジーを用いて作者の問いや表現したい世界を提示する場所です。

メディアアートかな…? と思うかもしれませんが、メディアアートがメディア装置を『使用』したアートなのに対し、SIGGRAPH のアートは、鑑賞者が実際に触れて体験して分かるアート、つまりインタラクティブアートが多いことが特徴です。

解説は割愛しますが、少しだけ写真をピックアップしたいと思います。

企業ブース

Unity や Unreal Engine が大型のなブースを構えるなか、日本からもいくつかの企業が出展していました。今回はその中から2社を紹介します。

CHEERS & FUJITSU SSL

日本から富士通の方がブースを構えておりました。解説してくださった展示内容は、『ARグラスに機械学習を用いたモデルにより自動翻訳した結果の文字列を表示する』というものでした。絶好調の時と比べて応答速度は普通…といった様子でしたが、これはクラウドと通信しているためであり、会場の回線速度に左右されていたようでした。

NIPPON CARBIDE

主に空中映像を投影するために利用される特殊な構造のプレート17)競合にはアスカネットのAIプレートが存在します。を製造している日本カーバイド工業も出展していました。

主に空中映像を投影するために利用される特殊な構造のプレート17)競合にはアスカネットのAIプレートが存在します。を製造している日本カーバイド工業も出展していました。

Posters

続いてポスター発表のブースにもお邪魔しました。そろそろ時間がないので日本人かつ知り合いを攻めていきましょう 😌 (ユルシテネ

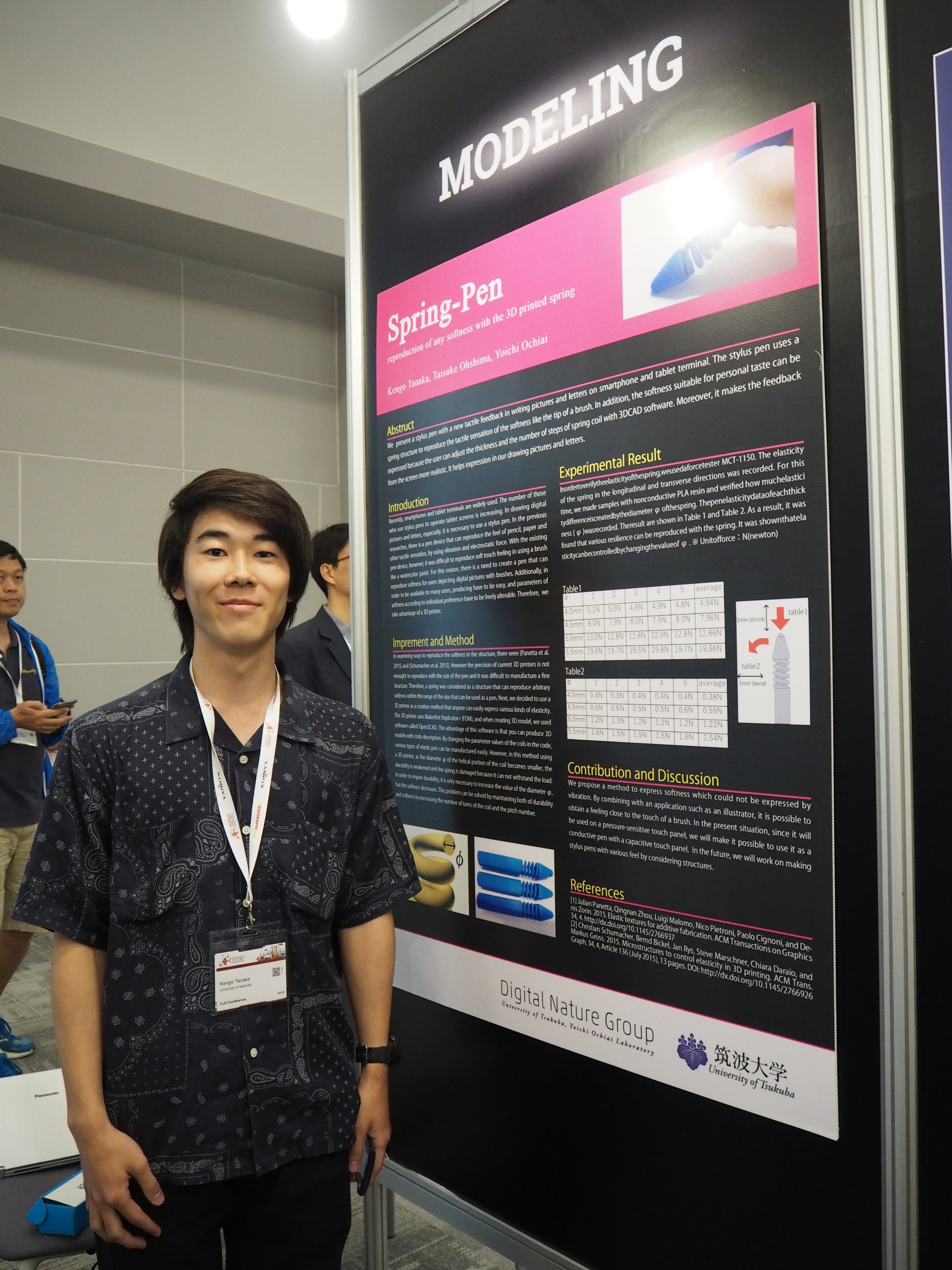

Spring-Pen: Reproduction of any Softness with the 3D Printed Spring

Aerial Image on Retroreflective Particles

Silk Fabricator: Using Silkworms as 3D Printers

Technical Papers

テクニカルペーパーは伝統的にレンダリング関係やBRDFなどの光を記述する研究が多くを占めますが、今回は完全に好みで、デジタルファブリケーション関連の研究をいくつかサクっとご紹介します。デジタルファブリケーションは、コンピューテーショナルファブリケーションであるともいえ、計算機による構造などの最適化と、3Dプリンタなどによる最新のファブリケーション技術を掛け合わせ、これまでにない「モノ」を作る研究分野です。ソフトロボティクス等にも強く関係してきます。

MetaSilicone: Design and Fabrication of Composite Silicone with Desired Mechanical Properties

https://www.disneyresearch.com/publication/metasilicone/

ディズニーリサーチの研究です。柔軟素材による物体のファブリケーションにおいて、望んだ形状の位置に望んだ剛性や伸び方等の属性を与える研究です。方法としては、シリコンの物体を作成する際に内部に水泡やシリコン胞を混入します。これらを決まった範囲に混入する際には、各々の形状や位置に様々な可能性が考えられます。本研究では、デザイナーの望んだ、たとえば触った際の堅さや伸び具合などの属性を得るために、この胞の位置や形状を最適化する方法を採っています。

Computational Design and Fabrication of Soft Pneumatic Objects with Desired Deformations

https://milkpku.github.io/project/pneumatic.html

柔軟素材による物体において、空気圧等により内圧を変化させた際に、物体がデザイナの意図通りの形状変化を起こすように設計する手法です。前述の研究と似ていますが、こちらは積極的に物体をアクチュエーションするという観点で全く異なる趣旨の研究です。適切な設計を施さずに柔軟素材によって形状を作成し、中に空気層を設けて膨らませた場合、たまたま薄くなっていた部分から膨らんでしまいます。本研究ではファブリケーションの際に、特定の方向に本体の形状を変化させるように最適化された、骨組みとなる比較的固い柔軟素材を一緒に3Dプリントすることにより、デザイナの意図した形状変化や動作を行う柔軟な物体を作成します。

3D Printing Wireless Connected Objects

https://homes.cs.washington.edu/~gshyam/Papers/3dwireless.pdf

3Dプリンタのみにより、バッテリーや電子回路無しに原始的な無線通信が可能な機構を自作する研究です。正確には、今回提案された機構は能動的に電波を発生するわけではありません。ではどのように通信するかというと、もともと周辺の環境に満ちあふれているようなWiFi等の電波を、この機構によって吸収・または反射し、これを0と1 (バイナリ) 等に対応させ、受信機で検知します。作り方は簡単で、まず3Dプリンタにより、非導電性のフィラメントで例えば歯車などの回転機構を作成します。また、今度は導電性のフィラメントによってアンテナとこれにモールス信号の発信器のようにトントンと触れるような端子を作成します。そして、先ほど作った歯車が回転したら、端子がアンテナを叩くような構造にこれらを組み立ます。このようにすれば、既にそこら辺を飛んでいる既存のWiFi電波に規則的なノイズ19)もはやこれはノイズではなく信号とります。をのせ、スマホなどの受信機でデコードすることができるようになります。このパターンに対応したソフトウェアなどを予め作成しておくことにより、3Dプリンタのみで作成した機構で、スマホなどとインタラクションすることが可能となります。

Closing Session: "Towards Stronger Human Connections In AR/VR"

3日間というあっというまの会期もおわり、閉会式です。冒頭でも紹介した本会議のサマリーが発表され、来年度の SIGGRAPH Asia 開催地である東京の紹介ムービーと、東京のジェネラルチェアからの挨拶で締めくくられました。

閉会式のあとは、ラストセッションに参加しました。AR/VRにおけるさらなる人々のつながりの向上がテーマのパネルディスカッションです。内容は割愛しますが、面白かったのが、遠隔地からの登壇者がフルボディキャプチャされたアバターとしてディスプレイに登場し、かつ会場の登壇者たちもキャプチャされたうえでVR空間上に投影され、現実とVRの空間が混ざった状態が背後の巨大なスクリーンに投影された状態でセッションが進むという方式を採っていたところでした。

ラストセッションも終わり、来年のシグアジは東京 ! ということで設営されていた東京ブース20)東京観光財団の方もブースに立たれていたようでした…!を眺めて、帰国の途につきました。

おわりに

いかがでしたでしょうか。ご紹介できたのはほんの一握りでしたが、気になる研究はありましたか…? ☺️

今回は昔からの SIGGRAPH の一大テーマであるレンダリングや光学系の研究を紹介するのは敢えて割愛してしまいましたが、それはまた別の機会に! なんせ書き出したら止まらない!!!! 😭 ともあれ、大変長らくお付き合いいただき、ありがとうございました 🙇

SIGGRAPH は CG、インタラクティブシステム、デバイス等など、未来を夢想するキッズ22)そう、我々です。たちが大好きそうなことはだいたいなんでもそろう、お祭りです23)それが、みんなクールにふざけている大まじめな学会というのが最高ポイントです。。ぜひこの記事が、こういった分野に興味を持って頂くきっかけとなれれば、そして実際に SIGGRAPH に遊びに行って、自分も何か研究してつくりたい! とおもって頂けるような仲間を得ることができたならば、とても嬉しいです。

ではまた! 👋

脚注

| ↑1 | これと双璧を成す学会としては規格等でも有名なIEEEが挙げられます。 |

|---|---|

| ↑2 | 夏は5日間あります! |

| ↑3 | ちなみに夏のSIGGRAPHの参加人数はもっともっと多いです。 |

| ↑4 | ヘッドマウントディスプレイの略。コンピュータグラフィクス (CG) によって作り上げたVR空間等に没入するために、体験者が頭部に装着するゴーグル型のデバイスです。VR用のHMDは、ユーザーの現実への視界を一切遮ったうえでVR空間を表示します。現実の空間にシースルーのHMDなどを用いてCGを重畳表示し、現実を情報で拡張した状態で視認するのはARと言い概念が別れています。基本的に、これらのHMDを装着したユーザーが何を体験し行動しているかということは、外見から判断するのは難しく、不可解な様子に見えてしまいます。 |

| ↑5 | 最近 (?) は特定の学会では「均等に最も貢献した」複数人の著者を同列に筆頭著者とすることができます。 |

| ↑6 | 今回は傍観者のトラッキングは省略しています。 |

| ↑7 | というのは半分冗談で、本当は出展者だけの手で展示するのがつらそうな場合は、ちゃんと張り付いて助けてくれます。(あとその謎デザインの Houdini Tシャツ、ちょっとほしいぞ…) |

| ↑8 | ここでは「実際の身体的」という意味で使用します。 |

| ↑9 | 生徒1人1人に学習内容・学習方法をマッチングする手法です。複数の生徒が同じ学習内容・学習方法にマッチすることもあります。 |

| ↑10 | おそらくこれをスマホ用簡易HMDで使用したのでしょうか。 |

| ↑11 | 人間にとってはこれが「理解」しているように感じられます。 |

| ↑12 | この分野は昔からNECが最強です。 |

| ↑13 | 発音、表情、動きの強弱や抑揚。 |

| ↑14 | 空中のハンドジェスチャをトラッキングできるIRカメラです。 |

| ↑15 | しかしこうやって見てると年を追うごとに進化がすさまじいです… |

| ↑16 | スピーカーと思って下さい。 |

| ↑17 | 競合にはアスカネットのAIプレートが存在します。 |

| ↑18 | 今回はガラスビーズを使用しています。 |

| ↑19 | もはやこれはノイズではなく信号とります。 |

| ↑20 | 東京観光財団の方もブースに立たれていたようでした…! |

| ↑21 | 独特のクールジャパン観。 |

| ↑22 | そう、我々です。 |

| ↑23 | それが、みんなクールにふざけている大まじめな学会というのが最高ポイントです。 |